سلام. در این مقاله تلاش دارم تا در حوزه پشتیبانی سایت وردپرس مقاله جدیدی را با نام Google Bard AI – از چه سایت هایی برای آموزش آن استفاده میکند ارائه کنم.

امیدوارم از این مقاله لذت کافی را ببرید.

Google’s Bard بر اساس مدل زبان LaMDA آموزش داده شده است. این مدل زبان با استفاده از مجموعه دادههایی به نام InfiniSet، که نسبتاً کم اطلاعات موجود است، ایجاد شده است. دادههای مورد استفاده در InfiniSet از محتوای اینترنتی برداشته شدهاند، اما ریشه و شیوه جمعآوری این دادهها نامشخص است.

در مقاله تحقیقاتی LaMDA 2022، انواع مختلف دادههای مورد استفاده برای آموزش مدل LaMDA فهرست شدهاند. به طور کلی، فقط 12.5 درصد از مجموعه دادههای عمومی مورد استفاده قرار گرفتهاند که این دادهها شامل محتوای خزیده شده از وب هستند، و 12.5 درصد دیگر از دادههایی که از ویکی پدیا جمعآوری شدهاند.

مجموعه داده بی نهایت گوگل

- Google Bard بر اساس یک مدل زبان به نام LaMDA است که مخفف آن است مدل زبان برای کاربردهای گفتگو.

- LaMDA بر روی مجموعه داده ای به نام Infiniset آموزش داده شد.

- Infiniset ترکیبی از محتوای اینترنتی است که عمداً برای افزایش توانایی مدل برای درگیر شدن در گفتگو انتخاب شده است.

مقاله تحقیقاتی LaMDA توضیح می دهد که چرا آنها این ترکیب محتوا را انتخاب کردند:

«…این ترکیب برای دستیابی به عملکرد قویتر در وظایف محاورهای انتخاب شد… در حالی که هنوز توانایی خود را برای انجام سایر وظایف مانند تولید کد حفظ میکند.

به عنوان کار آینده، ما می توانیم بررسی کنیم که چگونه انتخاب این ترکیب ممکن است بر کیفیت برخی از وظایف NLP دیگر انجام شده توسط مدل تأثیر بگذارد.

این مقاله پژوهشی در حوزه علوم کامپیوتر، با تمرکز بر گفتگو و دیالوگ، نتایج آموزش مدل زبانی LaMDA را ارزیابی کرده است. برای آموزش این مدل، از مجموعه دادههای حاوی 1.56 تریلیون کلمه شامل گفتگوهای عمومی از جمله انجمنها، شبکههای اجتماعی و متون وبسایتها استفاده شده است.

مجموعه داده از ترکیب زیر تشکیل شده است

- 12.5٪ داده های مبتنی بر C4

- 12.5% ویکی پدیای انگلیسی زبان

- 12.5٪ اسناد کد از وب سایت های برنامه نویسی پرسش و پاسخ، آموزش ها و موارد دیگر

- 6.25٪ اسناد وب انگلیسی

- 6.25٪ اسناد وب غیر انگلیسی

- 50٪ داده ها را از انجمن های عمومی باز می کند

بخش اول مجموعه دادههای Infiniset شامل C4 و ویکیپدیا است که به عنوان دادههای معتبر شناخته شده هستند. از این دو، مجموعه داده C4، که به زودی بررسی خواهد شد، یک نسخه فیلتر شده و ویژه از مجموعه داده Common Crawl است.

- تنها 25 درصد از داده ها از یک منبع نامگذاری شده است C4 مجموعه داده و ویکیپدیا).

- بقیه دادههایی که 75 درصد از مجموعه دادههای Infiniset را تشکیل میدهند، شامل کلماتی است که از اینترنت حذف شدهاند.

- مقاله تحقیقاتی نمیگوید چگونه دادهها از وبسایتها، از چه وبسایتهایی یا جزئیات دیگری در مورد محتوای خراششده بهدست آمده است.

- Google فقط از توضیحات کلی مانند “اسناد وب غیر انگلیسی” استفاده می کند.

- لغت کدر به معنای آن است که چیزی توضیح داده نشود و بیشتر پنهان باشد.

- Murky بهترین کلمه برای توصیف 75 درصد از داده هایی است که گوگل برای آموزش LaMDA استفاده کرده است.

اطلاعاتی وجود دارد که ممکن است به صورت تقریبی نشان دهند کدام وبسایتها در ۷۵ درصد محتوای وب موجود هستند، اما نمیتوانیم با اطمینان کامل به این موضوع پایبند باشیم.

مجموعه داده C4

Google Bard AI برای آموزش از مجموعه دادههایی استفاده میکند که از سایتهای مختلفی جمعآوری شدهاند. یکی از این مجموعههای داده، C4 نام دارد که در سال 2020 توسط گوگل توسعه داده شده است. این مجموعه داده بر اساس مجموعهداده Common Crawl ساخته شده و شامل دادههای خالص ساختارمند است.

درباره Common Crawl

Common Crawl یک سازمان غیرانتفاعی ثبت شده است که به صورت ماهانه صفحات وب را دنبال میکند و مجموعهدادههای رایگانی ایجاد میکند که برای استفاده عمومی در دسترس است.

تیم ادارهکنندهی این سازمان شامل افرادی است که تجربهی کاری در بنیاد ویکیمدیا، گوگل، Blekko و سایر شرکتهای فناوری را دارند. همچنین، برخی افراد مطرح در عرصهی فناوری نیز بهعنوان مشاور برای Common Crawl فعالیت میکنند، از جمله پیتر نورویگ، مدیر تحقیقات گوگل، و دنی سالیوان که هردو پیشینهی کاری در گوگل دارند.

چگونه C4 از Common Crawl توسعه یافته است

دادههای خام Common Crawl با حذف مواردی مانند محتوای نازک، کلمات زشت، لورم ایپسوم، منوهای ناوبری، حذف مجدد و غیره پاک میشوند. به منظور محدود کردن مجموعه داده به محتوای اصلی. هدف از فیلتر کردن دادههای غیرضروری حذف ابهامات و حفظ نمونههای انگلیسی طبیعی بود. این جمله را تغییر بده

این همان چیزی است که محققان سازنده C4 نوشتند:

«برای جمعآوری مجموعه دادههای پایه خود، متن استخراجشده وب را از آوریل ۲۰۱۹ دانلود کردیم و فیلتر فوقالذکر را اعمال کردیم.

این مجموعهای از متن را تولید میکند که نه تنها مرتبهای بزرگتر از بسیاری از مجموعههای دادهای که برای پیشآموزش استفاده میشوند (حدود ۷۵۰ گیگابایت) است، بلکه شامل متن انگلیسی نسبتاً تمیز و طبیعی است.

ما این مجموعه داده را “Colossal Clean Crawled Corpus” (یا به اختصار C4) دوبله می کنیم و آن را به عنوان بخشی از TensorFlow Datasets منتشر می کنیم.

نسخه های فیلتر نشده دیگری از C4 نیز وجود دارد. مقاله تحقیقاتی که مجموعه داده های C4 را توصیف می کند، با عنوان “کاوش در محدودیت های یادگیری انتقال با یک تبدیل کننده متن به متن یکپارچه” (PDF) است.

یک مقاله تحقیقاتی دیگر از سال 2021، (مستند کردن مجموعه های متنی بزرگ وب: مطالعه موردی در مجموعه عظیم Clean Crawled Corpus – PDF) ساختار سایت های موجود در مجموعه داده C4 را بررسی کرد.

جالب اینجاست که دومین مقاله تحقیقاتی ناهنجاریهایی را در مجموعه دادههای اصلی C4 کشف کرد که منجر به حذف صفحات وبی که همتراز با اسپانیایی تبار و آفریقاییتبار بودند، شد.

- صفحات وب همتراز شده با زبان اسپانیایی توسط فیلتر لیست بلاک (کلمات فحش و غیره) به میزان 32 درصد از صفحات حذف شدند.

- صفحات وب تراز شده آفریقایی آمریکایی با نرخ 42 درصد حذف شدند.

- احتمالاً این کاستی ها برطرف شده است…

- یافته دیگر این بود که 51.3 درصد از مجموعه داده C4 شامل صفحات وب است که در ایالات متحده میزبانی می شدند.

- در نهایت، تجزیه و تحلیل سال 2021 مجموعه داده اصلی C4 تأیید می کند که مجموعه داده تنها کسری از کل اینترنت را نشان می دهد.

در تحلیل مقاله c4 آمده است:

تجزیه و تحلیل ما نشان می دهد که در حالی که این مجموعه داده نشان دهنده بخش قابل توجهی از اینترنت عمومی است، به هیچ وجه نماینده دنیای انگلیسی زبان نیست و طیف وسیعی از سال ها را در بر می گیرد.

هنگام ساخت یک مجموعه داده از یک خراش وب، گزارش دامنههایی که متن از آنها خراشیده میشود برای درک مجموعه داده ضروری است. فرآیند جمعآوری دادهها میتواند منجر به توزیع بسیار متفاوت دامنههای اینترنتی با آنچه که انتظار میرود، شود.»

آمار زیر در مورد مجموعه داده C4 از دومین مقاله تحقیقاتی است که در بالا پیوند داده شده است.

25 وب سایت برتر (براساس تعداد توکن ها) در C4

- patents.google.com

- en.wikipedia.org

- en.m.wikipedia.org

- www.nytimes.com

- www.latimes.com

- www.theguardian.com

- journals.plos.org

- www.forbes.com

- www.huffpost.com

- Patents.com

- www.scribd.com

- www.washingtonpost.com

- www.fool.com

- ipfs.io

- www.frontiersin.org

- www.businessinsider.com

- www.chicagotribune.com

- www.booking.com

- www.theatlantic.com

- link.springer.com

- www.aljazeera.com

- www.kickstarter.com

- caselaw.findlaw.com

- www.ncbi.nlm.nih.gov

- www.npr.org

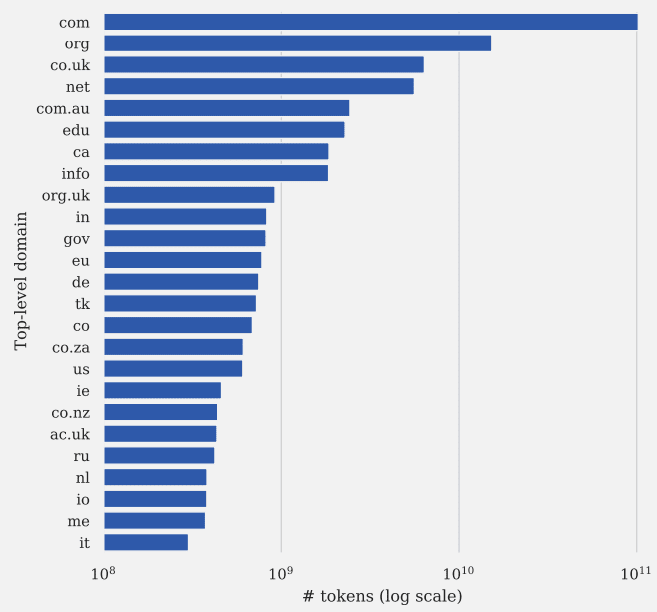

25 دامنه برتر سطح بالا در مجموعه داده C4

اگر به دنبال یافتن اطلاعات بیشتر در مورد مجموعه داده C4 هستید، پیشنهاد میکنم مستندسازی وسیع Webtext Corpora، یک مطالعه موردی در مجموعه عظیم Clean Crawled Corpus (که به صورت فایل PDF در دسترس است) و همچنین مقاله تحقیقاتی اصلی 2020 (نیز در قالب یک فایل PDF در دسترس است) که C4 برای آن ایجاد شده است، را مطالعه کنید.

دادههای دیالوگ از انجمنهای عمومی

- مقاله تحقیقاتی LaMDA گوگل درباره داده های آموزشی خود اظهار داشته است که 50 درصد از این داده ها از دیالوگ های انجمن های عمومی تشکیل شدهاند.

- این تمام چیزی است که مقاله تحقیقاتی LaMDA گوگل در مورد این داده های آموزشی می گوید.

- اگر بخواهیم حدس بزنیم، Reddit و دیگر جوامع برتر مانند StackOverflow شرطبندی مطمئنی هستند.

- Reddit در بسیاری از مجموعه دادههای مهم مانند مجموعههای توسعهیافته توسط OpenAI به نام WebText2 (PDF)، تقریبی منبع باز از WebText2 به نام OpenWebText2 و مجموعه دادههای WebText مانند (PDF) خود گوگل از سال 2020 استفاده میشود.

- گوگل همچنین یک ماه قبل از انتشار مقاله LaMDA جزئیات دیگری از مجموعه داده های سایت های گفتگوی عمومی را منتشر کرد.

- این مجموعه داده که حاوی سایت های گفتگوی عمومی است MassiveWeb نامیده می شود.

- ما حدس نمی زنیم که مجموعه داده MassiveWeb برای آموزش LaMDA استفاده شده باشد.

- اما این شامل یک مثال خوب از آنچه گوگل برای مدل زبان دیگری که بر دیالوگ متمرکز بود، انتخاب کرد.

سایت های گفتگوی عمومی موجود در MassiveWeb

- فیس بوک

- Quora

- یوتیوب

- متوسط

- سرریز پشته

این خبر نشان نمیدهد که مدل زبانی LaMDA با سایتهای فوق آموزش دیده باشد. بلکه با معرفی مجموعه دادهای به نام C4، که گوگل آن را به طور تقریبی همزمان با آموزش مدل LaMDA جمعآوری کرده است، این فرایند را انجام داده است. مجموعه داده C4 حاوی انواع سایتهای اجتماعی مانند انجمنها است که گوگل میتوانست برای آموزش مدل خود استفاده کند.

بدون دیدگاه